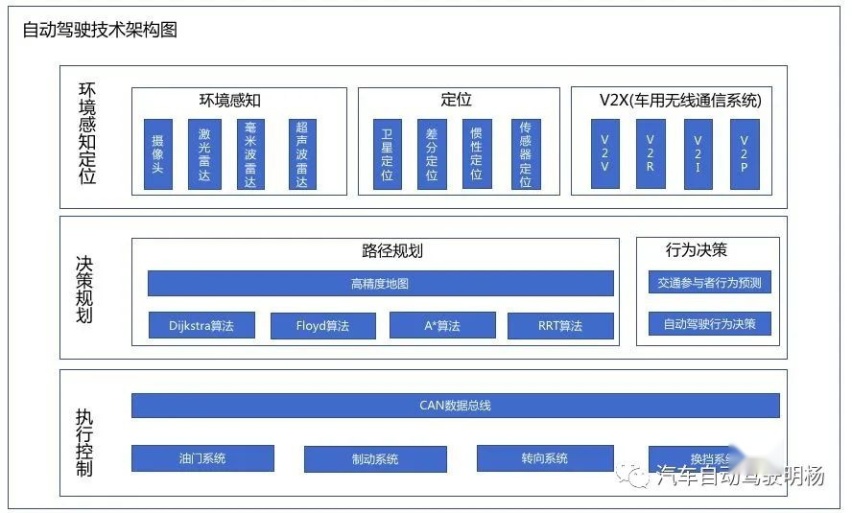

1. 高精地图

2. Dijkstra算法(是从一个顶点到其余各顶点的最短路径算法,解决的是有权图中最短路径问题)

3. Floyd算法(利用动态规划的思想寻找给定的加权图中多源点之间最短路径的算法)

4. A*算法(A*(A-Star)算法是一种静态路网中求解最短路径最有效的直接搜索方法也是解决许多搜索问题的有效算法。算法中的距离估算值与实际值越接近,最终搜索速度越快)

RRT算法(能快速的找出初始路径,之后随着采样点的增加,不断地进行优化直到找到目标点或者达到设定的最大循环次数)

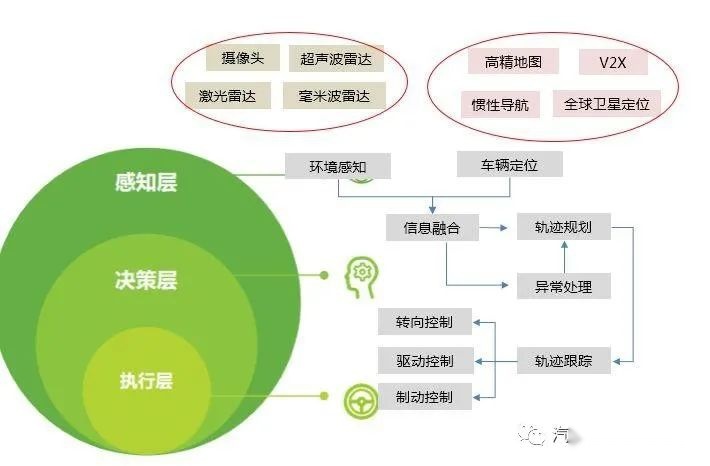

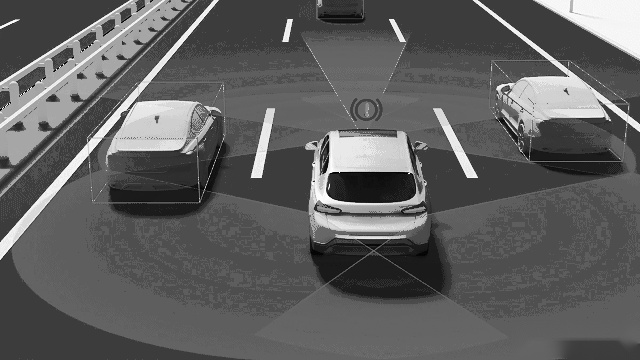

执行模块由CAN数据总线、横向控制执行及纵向控制执行组成。其中横向控制主要是由转向控制组成,而纵向控制则由加速控制、制动控制、换挡控制组成。

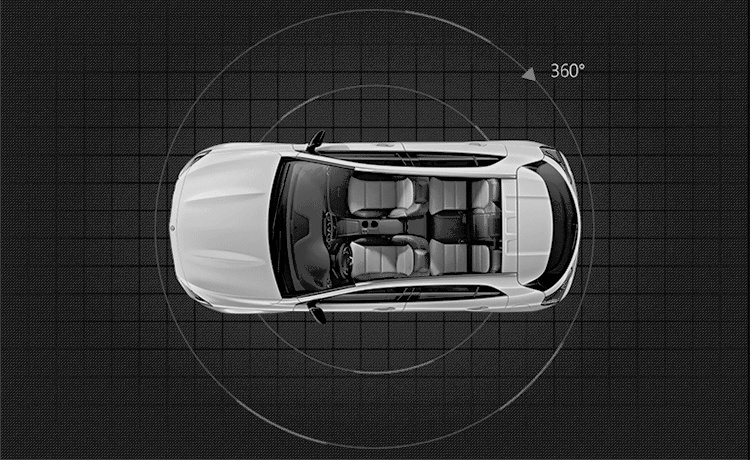

环境感知模块里面的摄像头按种类可分为:单目立体、双目立体、广角摄像头及夜视红外摄像头。

按安装位置不同,可分为前视、侧视、后视和内置四个部分;

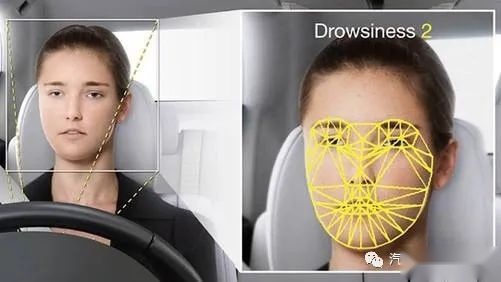

按功能应用又可分为行车辅助类、驻车辅助类与车内人驾驶员监控三大部分

(2)无法对非标准障碍物进行判断;

(3)距离并非真正意义上的测量,准确度较低。

(2)直接利用视差计算距离,精度比单目高;

(3)无需维护样本数据库,因为对于双目没有样本的概念。

(2)双目视觉系统通过估计视差来测距,而视差是通过立体匹配算法得来的,立体匹配是计算机视觉典型的难关;

(3)双目在线标定比单目要更复杂些,因为双目匹配需尽量简化成1-D搜索,所以需要通过stereo rectification将两个镜头光轴方向平行并和基线垂直。

1.防水 :车载摄像头密封要非常严实,满足在雨水中浸泡数日仍可正常使用;

8.使用寿命 :使用寿命至少为8~10年才能满足要求;

a、具备红绿灯识别及交通标志识别

汽车加油时频繁跳枪!是车出了问题,还是加油枪出了问题?

近期,“百万强汉 一路朝前——第100万汉车主交车暨汉L赛道体验日”活动盛大举行,众多媒体与用户齐聚比亚迪合肥赛车场,一同感受汉L的魅力!汉家族上市五年全球交付累计超过100万辆,成为中国品牌20万级首个交付破百万的车型!在中国汽车向上之路中,汉家族已成为一面鲜明旗帜!

“悦享自成” 2025 享界用户星享之夜,享界为用户带来了那枚迟到近一年的全新车标。

日前,知嘹汽车从网上获取到了一组全新问界新车的谍照。根据曝光的谍照来看,新车已经开始路测阶段,整体也是采用了家族式的设计语言,并将与问界M8、M9保持统一的视觉效果。同时,新车有可能取消单电机版本,仅保留双电机四驱版车型。据悉,新车将于今年8月开启预售,并于9月正式上市。

享界车标首发亮相,全新旅行车将于秋季上市

14.99万起!风云A9L上市,不给D级车留活路?

过去的6月,享界S9以单月交付4154辆的成绩,蝉联30万以上新能源轿车销量榜首。这一数据背后,是享界与用户深度共鸣的成果——中国品牌二十余年未突破的高端轿车领域,正被这个年轻品牌以“用户共创”模式重新定义。

开箱!把东风日产N7的AI座椅扛回家?太舒服了

广汽菲克宣告破产 国产Jeep正式谢幕!

奇瑞集团上半年销售汽车126万辆,创历史同期新高

方向盘贴钻、抱着方向盘开车,这样的做法都很危险!新手司机须知

风云A9L以13.99万抢购价,重构中大型混动轿车市场格局!

车载沙发变座椅,日产N7让你体验不同#开箱百万级大沙发 #东风日产N7

不同于之前我们参加的AMG活动,本次售价3万多的课程是有ADA认证的德国本土教练,而且分组培训的课程也有利于同车学员相互交流,本组教练Ronny也打破了德国人不够幽默的刻板印象。在中国规格最高的赛道上海国际赛道,开816匹的最强量产AMG,又会是一番怎样的体验?

王姨带你看车圈-开捷途山海T1的小姐姐一周穿搭

比亚迪乐高联动:科技创新启迪下一代

比亚迪在海外又传好消息回国了!他们在泰国罗勇工厂进行了第9万辆新能源车交付+工厂投产一周年双庆典!

补能速度有惊喜!两大重磅纯电SUV来袭,能解决“续航焦虑”?

听说小米最近很狂?别着急,特斯拉ModelY焕新版续航测试来了,来看看真实情况到底如何?下期我们测小米Yu7,大家拭目以待!

中国汽车品牌冲击高端市场的征程,始终面临着技术过剩与品牌势能的双重挑战。